Що таке EU AI Act і чому 2026 рік ключовий для всіх

Уявіть: ви пишете чат-боту в Telegram про пораду з інвестицій, а той раптом видає EU AI Act як останню волю Європи. Чесно кажучи, спочатку це лунало як фантастика. Але ні — це реальний закон, що вдихає життя в ШІ з людським обличчям. EU AI Act — перша у світі комплексна регуляція штучного інтелекту в ЄС. Він не просто папірці: це щит для ваших прав, демократії та навіть екології від диких витівок алгоритмів.

Закон офіційно стартував 1 серпня 2024-го. Через 20 днів після публікації в офіційному віснику ЄС — і ось він діє. Але повна сила? Тільки з 2 серпня 2026. Чому саме цей рік вибухає ключем? Бо саме тоді вмикаються правила прозорості ШІ. Ваші чат-боти, голосові асистенти, дипфейки в рекламі чи соцмережах — все мусять кричати: “Я ШІ!”. Без маркування — ніяк. Компанії змушені попереджати: спілкуєшся з машиною, а не людиною. Генеративний ШІ, як ChatGPT чи Midjourney, зобов’язаний позначати свій контент. Дипфейк з вашим обличчям у фейковому відео? Обов’язково з водяним знаком або ярликом.

Серце документа — ризико-орієнтований підхід. ШІ ділять на категорії, ніби фрукти за ступенем стиглості. Неприпустимий ризик — бан одразу. Соціальне скорингування, як у Китаї, де бал за поведінку вирішує твоє життя. Масове розпізнавання облич з камер чи інтернету без згоди. Маніпуляція емоціями в школах чи на роботі — стоп. Розпізнавання злочинців по профілю — геть. Ці заборони влилися в життя ще в лютому 2025-го.

Високий ризик — суворіший контроль. ШІ в медицині, банках, авто, освіті, виборах. Тут алгоритми мусять проходити тести: якісні дані, людський нагляд, журнали логів, кібербезпека. До серпня 2026-го для більшості, до 2027-го — для вбудованих у продукти, як ліфти чи літаки. А мінімальний ризик? Спам-фільтри, ігри з ШІ — лишаються вільними, без бюрократії.

Для звичайних користувачів це не абстракція. Ви в Україні користуєтеся TikTok чи Google? Екстратериторіальна дія AI Act хапає всіх, хто пропонує сервіси в ЄС. Українські стартапи з ШІ для Європи — під прицілом. Штрафи жахливі: до 35 мільйонів євро або 7% обороту. Тобто, Meta чи Google заплатять шалені гроші, якщо не маркуватимуть генеративний ШІ.

| Категорія ризику | Приклади | Дата дії |

|---|---|---|

| Неприпустимий | Соціальне скорингування, дипфейки без маркування, емоційне розпізнавання | Лютий 2025 |

| Високий | ШІ в охороні здоров’я, банках, працевлаштуванні | Серпень 2026–2027 |

| Прозорість | Чат-боти, GPAI моделі | Серпень 2026 |

Мета проста й жорстка: ШІ має служити людям, а не панувати. Захищає фундаментальні права — від приватності до недискримінації. Зв’язок з GDPR очевидний: автоматизоване прийняття рішень, профайлінг — під ударом. Ви маєте право знати, відмовитись, поскаржитись. 2026-й — не апокаліпсис, а пробудження. Компанії побіжать маркувати контент, ви отримаєте контроль. Готуйтеся: скоро кожен бот скаже правду про себе.

Класифікація ШІ-ризиків: що заборонено та контролюється

Уявіть: ви гортаєте стрічку в соцмережах, і раптом пост із вашим обличчям, але сказане – чиста брехня. Або банк відмовляє в кредиті через “скритий профіль ризику”, складений машиною. EU AI Act ріже такі сценарії корені. Ризик-орієнтований підхід ділить ШІ на чотири рівні: неприпустимий, високий, прозорості та мінімальний. Заборонене б’є по найгіршим загрозам правам людини. Контролюється – те, що може нашкодити, але при правильному управлінні – безпечне.

Почнемо з найжорсткішого. Неприпустимий ризик ШІ – це вісім практик, які просто заборонені. З лютого 2025 вони поза законом. Соціальне скорингування, як у Китаї, де влада оцінює громадян за поведінкою і карає балами – стоп. Масове розпізнавання облич в публічних місцях для поліції в реальному часі – ні. Емоційне сканування на роботі чи в школі, щоб шпигувати за почуттями? Забудьте. Біометрична категоризація, яка вираховує етнос чи орієнтацію за фото. А ще шкідлива маніпуляція – ШІ, що обманює вразливих, як діти чи літні. Збирання облич з інтернету чи камер без згоди для баз даних. Передбачення злочинів за особистістю. Чесно кажучи, це не фантастика – це те, що вже тестували, і Act зупинив.

| Заборонена практика | Приклад для користувача | Чому небезпечно |

|---|---|---|

| Соціальне скорингування | Оцінка поведінки в соцмережах для обмеження послуг | Втрата свобод, дискримінація |

| Реал-тайм біометрія для поліції | Скан облич на вулиці без причини | Масове стеження |

| Емоційне розпізнавання | Контроль настрою на роботі | Порушення приватності |

| Маніпуляція вразливими | Обман пенсіонера фейковими дзвінками | Експлуатація слабкостей |

Тепер високий ризик ШІ. Ці системи не заборонені, але під пильним контролем. Правила стартують у серпні 2026. Йдеться про ШІ в транспорті – автономні авто мусять тестувати ризики, логувати кожен кілометр, забезпечувати людський нагляд. У здоров’ї – діагностика раку чи сердечників: датасети чисті, без упереджень за расою чи статтю. Освіта: алгоритми, що сортують учнів на “здатних” і “ні” – тільки з документацією, стійкістю до хаків. Працевлаштування: сканер резюме не дискримінує жінок чи мігрантів. Критична інфраструктура – охорона мостів чи електромереж. Державні послуги: розподіл пільг чи міграція. Перед випуском – оцінка ризиків, traceability, висока точність. Для українців це значить: якщо ви користуєтеся європейським банком чи авіарейсом, ваші дані в безпеці від сліпих алгоритмів.

- Ризик-менеджмент: тест на “розумно передбачуване зловживання”, як хакерський вплив.

- Датасети: мінімум упереджень, висока якість.

- Документація: все для аудиторів, від коду до метрик.

- Людський оверсайт: кнопка “стоп” для машини.

- Кібербезпека: стійкість до атак.

Прозорість – окрема категорія, про неї детальніше в наступному розділі, але коротко: чат-боти мусять зізнаватися, що вони не люди. Генеративний ШІ – маркування дипфейків. А мінімальний ризик, як спам-фільтри чи ігри з ШІ – вільні, без правил. Перехід плавний: заборони вже діють, високий ризик – з 2026. Для звичайних користувачів це захист від маніпуляцій у повсякденні. Ви телефонуєте в підтримку – чуєте “я ШІ”? Бачили фейк-відео політики – позначка? Act робить ШІ надійним, не монстром. І це лише початок змін.

Прозорість ШІ у 2026: чат-боти та контент, який ви бачите щодня

Уявіть: пишеш у чаті з “підтримкою” банку, отримуєш блискавичну відповідь. Зручно? Безумовно. Але з серпня 2026-го EU AI Act змусить компанії кричати: “Це робот!”. Чесно кажучи, я сам колись годинами сперечався з ботом, думаючи, що це лінивий менеджер. Тепер усе зміниться – радикально й назавжди.

Обов’язкове повідомлення про спілкування з ШІ

З 2026 року кожен чат-бот ШІ, голосовий асистент чи віртуальний консультант зобов’язаний одразу заявляти: “Я – штучний інтелект”. Не десь у дрібному шрифті, а помітно, machine-readable – щоб програми теж розпізнавали. Взяти ChatGPT чи Gemini: розробники розкриють принципи роботи, дані для навчання, заходи безпеки. Для GPAI моделей (генеративних з високим ризиком) – повна документація.

Приклад? Замовляєш піцу через апку. Бот каже: “Привіт, я ШІ-асистент PizzaBot. Хочеш поговорити з людиною?”. Відмовишся – отримаєш номер телефону чи email. EU наголошує: боти – лише доповнення. Головне – доступ до живої розмови, бо суд ЄС уже постановив: споживач має право на швидкий контакт з людиною. А для високоризикових систем, як кредитний скоринг чи перевірка на соцдопомогу, – обов’язковий людський нагляд. Ти запитуєш про позику, бот оцінює – але людина перевіряє й пояснює логіку.

- Боти в банках: попереджають про автоматизоване рішення, дають право на перегляд людиною.

- Голосові асистенти в магазинах: фіксують розмови в “durable medium” – скачимий файл з таймстемпом.

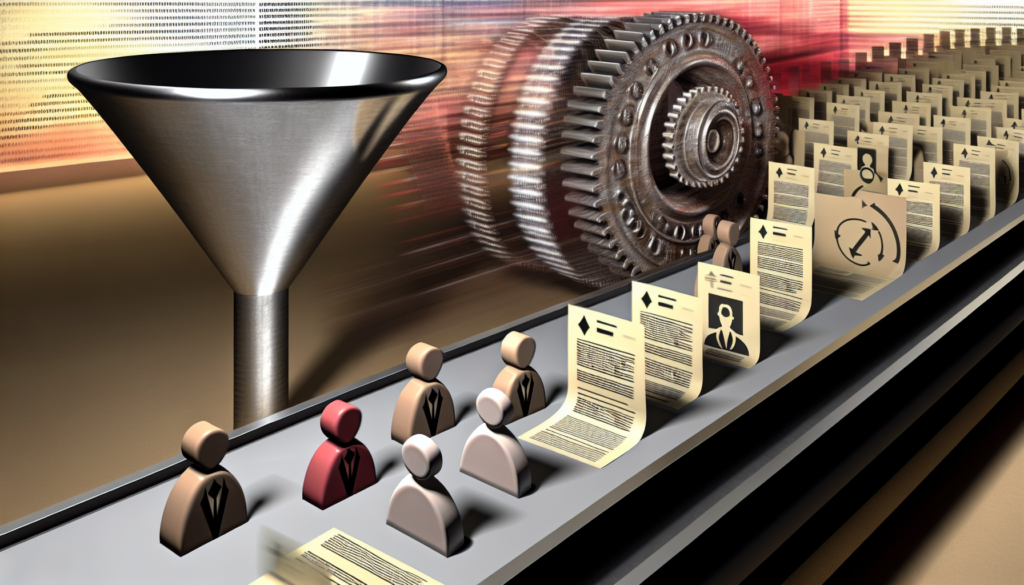

- Рекрутинг: ШІ відсіває резюме? Повідомляє: “Це алгоритм”, і ти вимагаєш пояснень.

Чому це круто? Бо маніпуляції кінець. Бот не обдурить, що “це від реальної людини”.

Маркування дипфейків та генеративного контенту

Скроліш Instagram – раптом фото знаменитості з твоїм обличчям у рекламі. З 2026-го маркування ШІ-контенту стане нормою. Дипфейки, генеровані тексти, зображення – усе позначать чітко, машинночитабельно. Виняток: дрібні правки, як автокорекція фото.

Деталі? Постачальники генеративного ШІ забезпечать ідентифікацію. Текст для новин? Мітка “Створено ШІ”. Реклама з фейковим відео? Водяний знак чи тег. У соцмережах алгоритми ранжування розкриють параметри – чому цей пост на першому місці? За UCPD (директива про нечесні практики) фейкові відгуки заблокують.

| Тип контенту | Обов’язкове маркування | Приклад |

|---|---|---|

| Дипфейки | Помітне + machine-readable | Відео політики з фальшивим голосом |

| Генеративний текст | Чітка мітка для публікацій | Стаття чи пост у Facebook |

| Зображення/аудіо | Водяний знак або тег | Реклама з ШІ-моделлю |

Для українців це реальність уже зараз, бо екстратериторіальна дія AI Act хапає сервіси, що працюють з ЄС. TikTok чи Google з українським трафіком? Підпадуть під правила. Штрафи? До 3% обороту – $17 млн для гігантів.

Емоційно? Я радів би, якби раніше знали правду про фейки в новинах. Тепер ти контролюєш: бачиш мітку – сумніваєшся, перевіряєш джерело. Прозорість не стримуватиме інновації, а очищатиме простір. Готовий до 2026-го? Бо чат-боти вже не ті.

Захист приватності: як AI Act впливає на ваші дані

Уявіть: ви залишили коментар під постом у соцмережі, поставили лайк кільком оголошенням, і раптом реклама починає переслідувати вас по всьому інтернету. Це не магія — це системи штучного інтелекту, які аналізують ваші дані та передбачають, що вам може сподобатися. До 2026 року правила цієї гри змінюються радикально. EU AI Act запроваджує жорсткі вимоги щодо того, як компанії можуть збирати, аналізувати та використовувати вашу інформацію через ШІ-системи. Це не просто технічна деталь — це ваше право знати, коли машина приймає рішення про вас.

Автоматизоване прийняття рішень: коли ШІ вирішує за вас

Одна з найбільш інвазивних практик — коли алгоритм вирішує, чи отримаєте ви кредит, чи пройдете співбесіду, чи будете схвалені для оренди квартири. AI Act встановлює чіткі правила для таких систем. Якщо ШІ приймає рішення, яке суттєво впливає на ваше життя (так звані системи високого ризику), компанія зобов’язана забезпечити ефективний людський контроль. Це означає, що реальна людина повинна мати можливість зрозуміти, як машина прийшла до висновку, перевірити його, відхилити або зупинити процес.

Чесно кажучи, раніше цього не було. Алгоритм міг відмовити вам у кредиті, і ви просто отримували “ні” без пояснень. Тепер компанія повинна надати вам зрозумілу інформацію про те, як працює система, які дані вона використовувала, і чому прийшла до такого рішення. Якщо ви не згодні — у вас є право оскаржити це рішення перед живою людиною.

Профайлінг та обробка спеціальних категорій даних

AI Act тісно пов’язаний з GDPR, але йде далі. Якщо ШІ-система обробляє так звані “спеціальні дані” (інформація про расу, етнічне походження, політичні погляди, релігію, генетичні дані, здоров’я або сексуальну орієнтацію), правила стають ще суворішими. Компанії не можуть просто так збирати цю інформацію для навчання алгоритмів.

Практичний приклад: припустимо, соцмережа розробляє систему для таргетування реклами. Вона не може використовувати ваші дані про здоров’я або релігійні переконання, щоб показувати вам специфічну рекламу, навіть якщо ви дали якесь загальне дозволу на обробку даних. AI Act вимагає явної, конкретної згоди саме на такий вид обробки.

| Тип даних | Що заборонено | Що дозволено з обмеженнями |

|---|---|---|

| Спеціальні категорії (здоров’я, релігія, раса) | Обробка для таргетування реклами без явної згоди | Обробка для медичних цілей або захисту від дискримінації з суворим контролем |

| Біометричні дані (обличчя, відбитки пальців) | Масове розпізнавання облич у публічних місцях правоохоронцями | Розпізнавання для безпеки аеропортів або розслідування серйозних злочинів з судовим наглядом |

| Дані про поведінку та переваги | Маніпулятивне профайлінг для експлуатації вразливостей (діти, люди з інвалідністю) | Персоналізація контенту з прозорою інформацією про те, як працює система |

Право на невтручання ШІ-систем та запит інформації

До 2026 року у вас з’являється конкретне право: ви можете запросити у компанії детальну інформацію про те, як ШІ-система обробляє ваші дані. Це не просто формальне право — компанія зобов’язана відповісти в розумний термін зрозумілою мовою.

Крім того, ви маєте право не підкорятися рішенням, прийнятим виключно на основі автоматизованої обробки, якщо це рішення суттєво впливає на вас. Наприклад, якщо система ШІ відмовила вам у роботі, ви можете вимагати, щоб реальний рекрутер переглянув вашу кандидатуру.

Псевдонімізація та обмеження повторного використання даних

AI Act вимагає від компаній, які розробляють системи штучного інтелекту, застосовувати так звану “псевдонімізацію” — це коли ваші дані обробляються таким чином, що їх важко пов’язати з конкретною людиною. Якщо компанія зібрала дані для однієї мети (наприклад, для покращення рекомендацій фільмів), вона не може просто так використовувати ці ж дані для іншої мети (наприклад, для медичного дослідження).

Це означає кінець епохи, коли ваші дані перепродавалися та використовувалися для сотні різних цілей без вашого відома. Кожен новий вид обробки вимагає нової згоди.

Документування та право на забування

Компанії, які використовують ШІ-системи для обробки ваших даних, зобов’язані вести детальні логи цієї діяльності. Це потрібно для того, щоб у разі проблеми можна було відстежити, що сталося. Якщо система прийняла помилкове рішення, яке вас зашкодило, ви можете вимагати компенсацію, опираючись на ці логи.

Також у вас залишається право на забування — ви можете вимагати видалення ваших даних після того, як вони більше не потрібні для первісної мети. Якщо компанія навчила ШІ-модель на ваших даних, а потім ви запросили видалення, компанія не може просто “забути” про це. Вона повинна переглянути, чи можна перетренувати модель без ваших даних.

Звучить складно, але суть проста: ваші дані — це ваша власність, і компанії не можуть робити з ними все, що захочуть. До 2026 року цей принцип стає обов’язковим по всій Європі, включаючи українські компанії, які надають послуги в ЄС.

Практичні зміни для українців: екстратериторіальна дія та штрафи

Уявіть: ви в Києві запускаєте улюблений чат-бот для поради щодо інвестицій. А він раптом блокується. Чому? Бо його розробники в Україні не врахували EU AI Act, який діє екстратериторіально. Так, цей закон не зупиняється на кордонах ЄС. Він хапає за горло будь-яку компанію, чиї сервіси торкаються Європи. Чесно кажучи, для нас, українців, це як несподіваний грім: наші додатки, сайти, ШІ-інструменти раптом мусять грати за правилами Брюсселя.

Вплив на українські сервіси та додатки (якщо використовуються в ЄС)

Екстратериторіальна дія – ключовий гачок. Якщо ваш український стартап пропонує генеративний ШІ чи чат-боти для клієнтів у ЄС, ви під прицілом. Закон застосовується до постачальників ШІ-систем, які розміщують продукти на ринку ЄС, незалежно від локації фірми. Навіть якщо сервер у Львові, а користувач у Варшаві – правила діють.

Приклад: візьміть популярний український сервіс розпізнавання облич для безпеки. Якщо його інтегрують у європейські банки чи аеропорти, це високий ризик ШІ. Розробник мусить провести оцінку ризиків, забезпечити людський нагляд, вести логи. Не зробив? Сервіс вилітає з ЄС. А ми, користувачі, бачимо: “Цей інструмент не відповідає EU AI Act 2026“.

Ще історія з реального життя. Друг розробляв мобільний додаток з профайлінгом ШІ для рекомендацій контенту. Клієнти з Польщі скаржаться – і bum! Компанія змушена маркувати весь контент, додавати повідомлення “Ви спілкуєтеся з ШІ”. Без цього – блокування. Для українців це означає: оновлюйте додатки вже зараз. Перевіряйте, чи є у вашого сервісу сертифікат відповідності. Інакше прощавайтеся з європейським ринком.

Технічний нюанс: для GPAI моделей (як ChatGPT-подібні) потрібна документація про тренувальні дані, обмеження, ризики. Українські фрілансери на Upwork, які продають ШІ-моделі європейцям, ризикують. ЄС вимагає traceability – повний ланцюжок даних від тренування до випуску.

Штрафи для компаній та ваші права на скаргу (до €35 млн)

Штрафи – це молот. Вони tiered, залежно від порушення. Найгірше для неприпустимого ризику ШІ: до €35 млн або 7% глобального обороту. Уявіть OLX чи Rozetka з ШІ-рекламою, яка маніпулює – штраф з’їсть прибуток.

| Порушення | Максимальний штраф | Відсоток обороту |

|---|---|---|

| Заборонені ШІ-практики (соціальне скорингування, масове розпізнавання) | €35 млн | 7% |

| Порушення для високого/обмеженого ризику (прозорість, дані) | €15 млн | 3% |

| Хибна інформація для органів | €7.5 млн | 1.5% |

Для GPAI – окремо до €15 млн або 3%, якщо не надали документацію чи заблокували аудит. Компанії можуть оскаржити в Суді ЄС, але це роки. Гроші йдуть до бюджету ЄС.

А ваші права? Супер! Якщо ШІ порушив приватність – скаржтеся до національних органів ЄС чи EDPS. Українці, які користуються сервісами в ЄС, захищені. Приклад: ви в Telegram з європейським ботом, який не позначив дипфейк. Пишіть скаргу – і отримайте компенсацію. Навіть з України: через GDPR-зв’язок, бо AI Act посилює захист даних.

Перехід до дій: перевіряйте маркування в чат-ботах. Бачили “Це генерує ШІ”? Добре. Ні – скаржтеся. Для бізнесу: готуйтеся до 2026. Тестуйте на відповідність. Це не кінець світу, а шанс стати надійнішим.

Поради звичайним користувачам: як адаптуватися до нових правил

Уявіть: ви пишете чат-боту в Instagram, а той раптом зізнається — “Я ШІ, не людина”. Шок? Ні, з 2026-го це норма. EU AI Act змушує компанії грати чесно. Чесно кажучи, для нас, звичайних українців, це шанс повернути контроль. Не панікуйте — ось конкретні кроки, щоб не загубитися в цьому ШІ-хаосі.

Перевіряйте маркування: дипфейки та генеративний контент не ховаються

З серпня 2026-го кожен дипфейк чи текст від генеративного ШІ мусить нести водяний знак або мітку. Платформи на кшталт TikTok, Meta чи YouTube вже тестують це: автоматичні лейбли “AI-generated” на синтетичних відео чи аудіо. Використовуйте їх. Бачили фейкове відео політика? Шукайте мітку в метаданних або описі. Без неї — скаржтеся в платформу. Приклад: у рекламі Instagram з січня 2026-го Meta дає вибір — повна персоналізація чи мінімальна. Оберіть останню, щоб уникнути профайлінгу ШІ.

- Скрольте стрічку уважно: шукайте іконки чи текст “Створено ШІ”.

- Для фото/відео — перевірте метадані через інструменти платформ (TikTok’s Content Credentials).

- Реклама? Налаштуйте в Facebook/Instagram: обмежте дані для таргетингу, щоб ШІ не копирсався в вашій історії пошуку.

Вимагайте прозорості: з чат-ботами та асистентами говорите прямо

Бот у Telegram чи голосовий помічник у авто? З 2026-го вони зобов’язані зізнаватися одразу: “Привіт, я генеративний ШІ“. Якщо мовчить — питайте самі: “Ти ШІ?”. Відмова відповідати — привід ігнорувати пораду. У чатах з банками чи сервісами вимагайте людину для важливих рішень. Автоматизоване рішення про кредит? Право оскаржити — базова норма, пов’язана з GDPR.

- Задавайте тестові питання: “Розкажи анекдот про себе” — ШІ видасть себе.

- У соцмережах читайте налаштування приватності: відключайте автоматизоване прийняття рішень.

- Для українців: українські апки як monobank чи Rozetka, що працюють з ЄС, теж адаптуються — тестуйте нові сповіщення.

Захищайте дані: інструменти проти профайлінгу та ризиків

Прозорість ШІ — це не просто слова. EU AI Act блокує соціальне скорингування чи маніпуляції вразливостями. Використовуйте VPN для анонімності, браузери з блокуванням трекерів (наприклад, Brave). Налаштуйте cookie-консент: забороняйте обробку персональних даних для ШІ-моделей. Приклад: у YouTube вимикайте персоналізовані рекомендації — менше високого ризику ШІ в стрічці.

| Ситуація | Дія | Результат |

|---|---|---|

| Чат-бот радить покупку | Запитайте: “Ти ШІ? Які дані використав?” | Отримати розкриття або перейти до людини |

| Підозрілий дипфейк у TikTok | Перевірте лейбл + репортуйте | Контент видаляють, аккаунт блокується |

| Персоналізована реклама в Meta | Оберіть “мінімальний таргетинг” | Менше профайлу, більше приватності |

| Авторішення (кредит, бан) | Оскаржуйте письмово | Право на людський перегляд |

Ці звички врятують години. З 2026-го права користувачів ШІ стають реальністю — екстратериторіальна дія діє скрізь, де є ЄС-аудиторія. Тестуйте зараз, бо штрафи до €35 млн змусять компанії слухатися. Ви — не жертва, а гравець.

Майбутнє ШІ в Європі: інновації без ризиків

Уявіть: 2026 рік. Ви гортаєте стрічку в Instagram, і раптом фото вашого улюбленого блогера оживає з ідеальною посмішкою, якої насправді не було. Дипфейк. Або чат-бот у Telegram радить рецепт борщу, ніби ваша бабуся. З серпнем 2026-го Європа каже: стоп, маркуй це чітко! EU AI Act не душить інновації – навпаки, вичищає хаос, щоб ШІ служив людям, а не дурив.

Чесно кажучи, після років боїв з дипфейками та маніпуляціями, цей акт – як свіжий подих. Розробники генеративних моделей, типу ChatGPT чи Gemini, мусять розкривати, як навчають свої звірі: які дані ковтали, які ризики ховають. European AI Office злізе на них з перевірками саме з серпня 2026-го для свіжих моделей. Старіші – з 2027-го. Це не бюрократія. Це щит для вашого мозку.

Баланс: ШІ летить уперед, але з парашутом

Європа не зупиняє ракети. Навпаки. Ризико-орієнтований підхід AI Act дозволяє 99% ШІ – від ігор до спам-фільтрів – жити спокійно, без паперів. Високий ризик? Транспорт, медицина – там жорсткий контроль. А генеративний ШІ? GPAI-моделі тепер звітують про безпеку, захищають авторські права. Уявіть: ви створюєте мем з ШІ – і бачите водяний знак “Згенеровано ШІ”. Прозоро. Надійно.

- Соцмережі: Meta з січня 2026-го дає вибір – повна персоналізація реклами чи мінімальна, без платної підписки. TikTok, YouTube, Instagram вже мітять AI-контент автоматом.

- Реклама: Британські рекламники, що лізуть в ЄС, вбудовують метадані та водяні знаки. Deepfakes з обличчям політика? Маркування обов’язкове, інакше – штрафи до 3% обороту.

- Користувачі: Ви знаєте, що бесідуєте з ботом. Рішення обдумане, не сліпе.

Приклад з життя. Олена з Києва постить у Facebook фото з відпустки, згенероване Midjourney. Без мітки – ризик блокування. З міткою – лайки летять, довіра росте. Компанії вкладають у “надійний ШІ”, бо штрафи – до €35 млн. Це стимул для інновацій: кращі моделі, прозоріші алгоритми.

| Ризик ШІ | Зміни з 2026 | Вплив на вас |

|---|---|---|

| Генеративний контент | Маркування deepfakes, текстів для публіки | Знаєте, що фейк – не клюнете |

| Чат-боти | Повідомлення “Ви говорите з ШІ” | Не витрачаєте час на ілюзію |

| Реклама з ШІ | Водяні знаки, метадані | Контролюєте персоналізацію |

А тепер про майбутнє. З 2026-го ЄС запускає sandbox’и – тест-полігони для ШІ в кожній країні. Інновації цвітуть: нові GPAI без ризиків, інструменти для маркування готові до Q2 2026-го. Україна? Екстратериторіальна дія чіпляє нас, якщо сервіси йдуть в ЄС. Ми адаптуємося – і виграємо. ШІ стане другом, а не вовком в овечій шкурі. Готуйтеся: прозорість – це нова норма. Ваш вибір тепер реальний.